Standardmäßig bietet Alter eine Vielzahl von Modellen an, die alphabetisch nach ihrem Hosting-Anbieter aufgelistet sind. Sie können auch Ihren API-Schlüssel verwenden oder Ihr lokales Modell nutzen.Documentation Index

Fetch the complete documentation index at: https://docs.alterhq.com/llms.txt

Use this file to discover all available pages before exploring further.

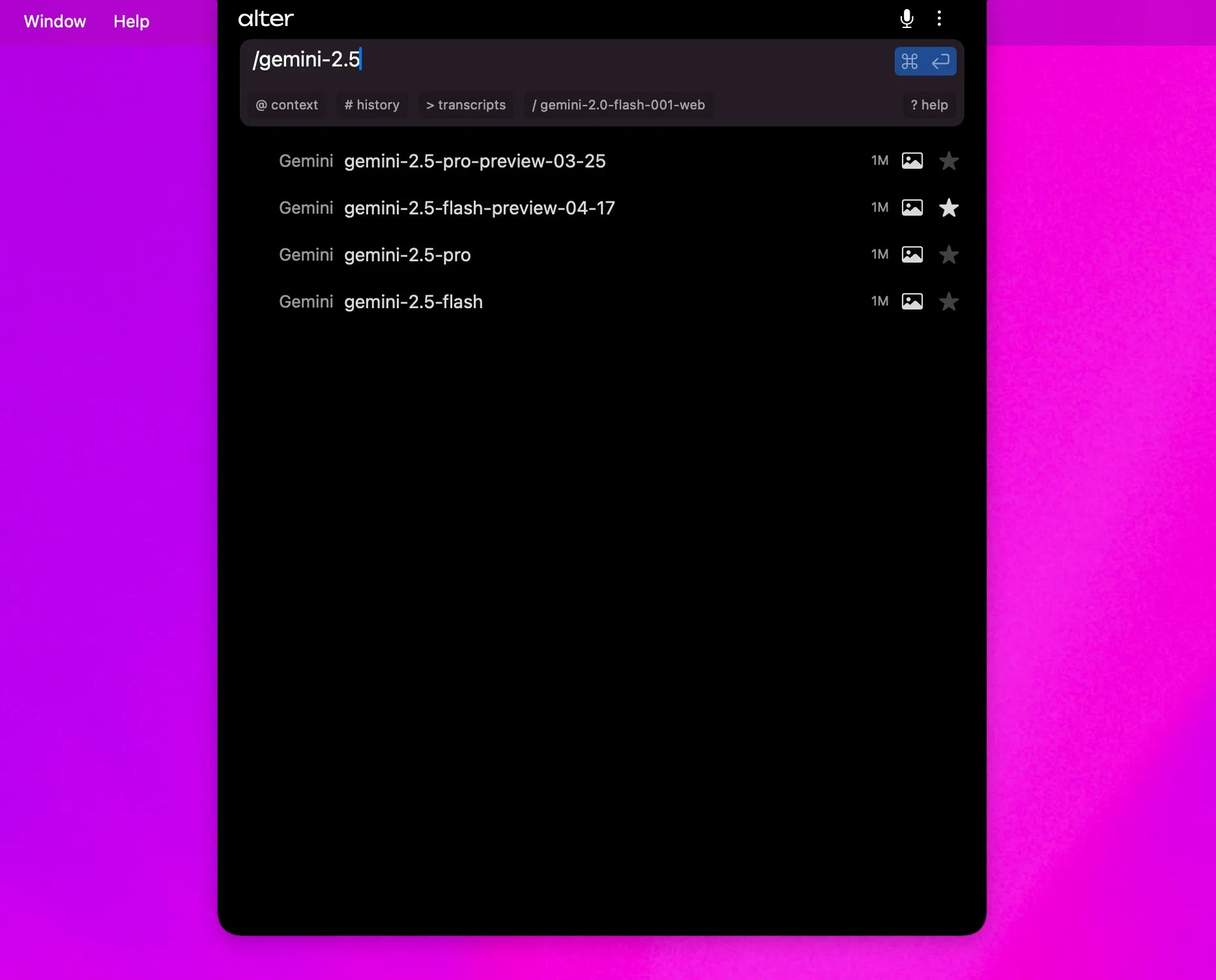

Auswahl Ihres Modells

Öffnen Sie Alter und geben Sie einfach/ ein, um die verfügbaren Modelle anzuzeigen und das Modell auszuwählen, das Sie verwenden möchten.

Auswahl eines bevorzugten Modells

Wählen Sie das Sternsymbol neben einem Modell mit der Maus aus, um das Modell als Ihr Favorit zu markieren.\

Alle anderen Interaktionen laufen über Alter Cloud.

Verwendung von Alter Cloud

Standardmäßig ist Alter mit/best eingerichtet, unserem internen Modellrouter, der das beste Modell basierend auf Ihrer Abfrage auswählt.

/ aus, und es wird sofort Ihr Standardmodell. Es bleibt aktiv, bis Sie ein anderes Modell auswählen.

Liste der Modelle über Alter Cloud

Alter bietet Zugriff auf 92+ Modelle von 10 Anbietern über seinen einheitlichen Router. Verwenden Sie den/models-Endpunkt, um die aktuellen Modelle aufzulisten, oder sehen Sie sich den API Gateway Guide für detaillierte Modellinformationen an.

Anbieterübersicht (Stand Beta 71):

| Anbieter | Modellanzahl | Beispielmodelle |

|---|---|---|

| Alter | 4 | best, fair, fast, light |

| Claude (Anthropic) | 4 | claude-sonnet-4-6, claude-sonnet-4-20250514 |

| OpenAI | 17 | gpt-4o, gpt-4o-mini, gpt-5, o3, o4-mini |

| Gemini (Google) | 10 | gemini-2.5-pro, gemini-2.5-flash, gemini-3-pro-preview |

| Mistral | 9 | mistral-small-latest, codestral-2501, pixtral-large-latest |

| Groq | 7 | Llama, Qwen und andere optimierte Modelle |

| Together | 26 | DeepSeek, Llama, Qwen und Spezialvarianten |

| xAI | 8 | grok-3-latest, grok-4 Serie |

| Cerebras | 5 | Llama, Qwen und DeepSeek-Varianten |

| Perplexity | 2 | sonar, sonar-pro (websuchfähig) |

| Merkmal | Modelle | Kontext |

|---|---|---|

| Vision Fähig | GPT-4O, Gemini 2.5+, Claude, Mistral Pixtral | Analysieren von Bildern/Videos |

| Höchster Kontext | Alter Modelle, Gemini | 1M+ Tokens |

| Schnellste | Alter light, GPT-4O mini, Gemini Flash | Niedrige Latenz |

| Fähigsten | GPT-4O, Gemini 2.5 Pro, Claude Sonnet | Komplexes Denken |

| Websuche | Perplexity Sonar | Echtzeitinformationen |

| Code Spezialist | Mistral Codestral | Code-Generierung |

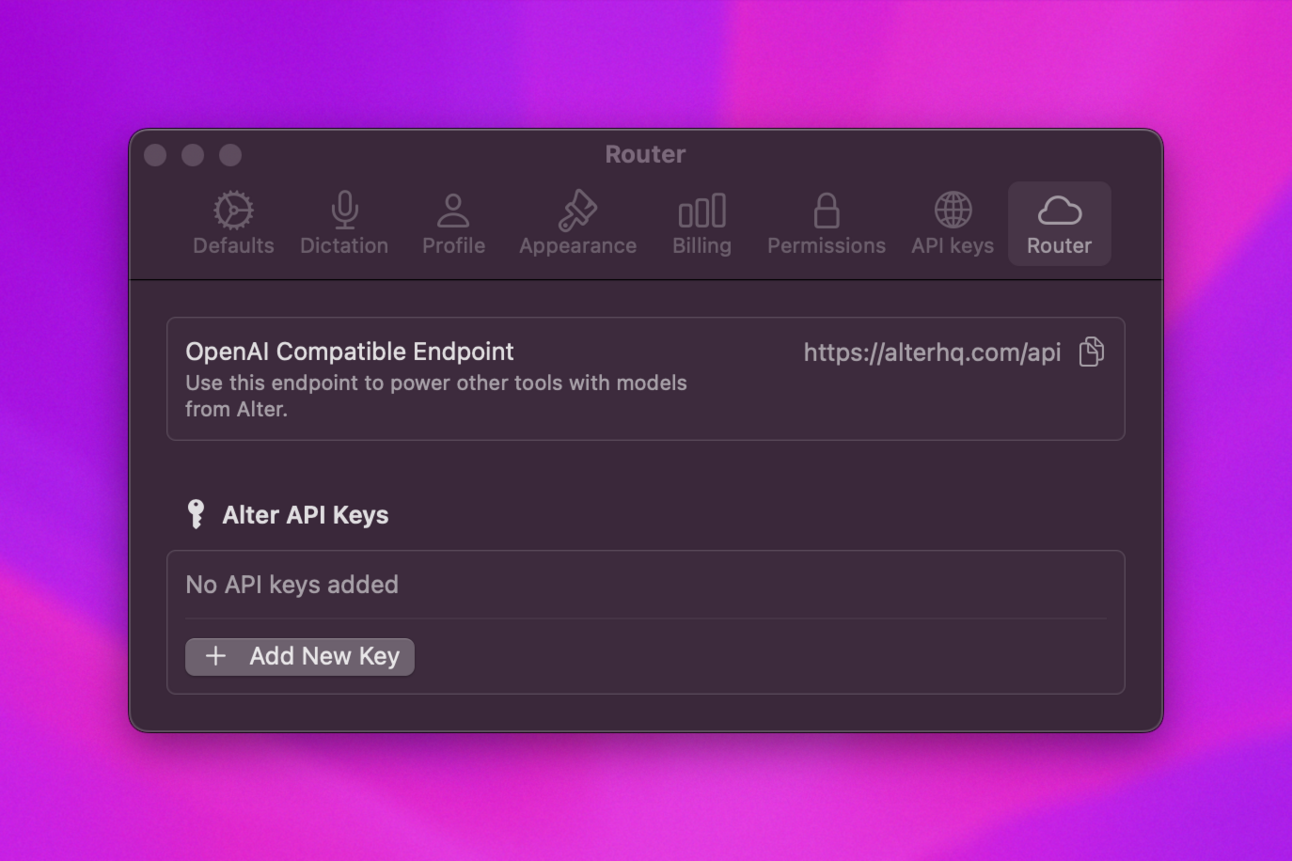

Verwendung Ihres API-Schlüssels

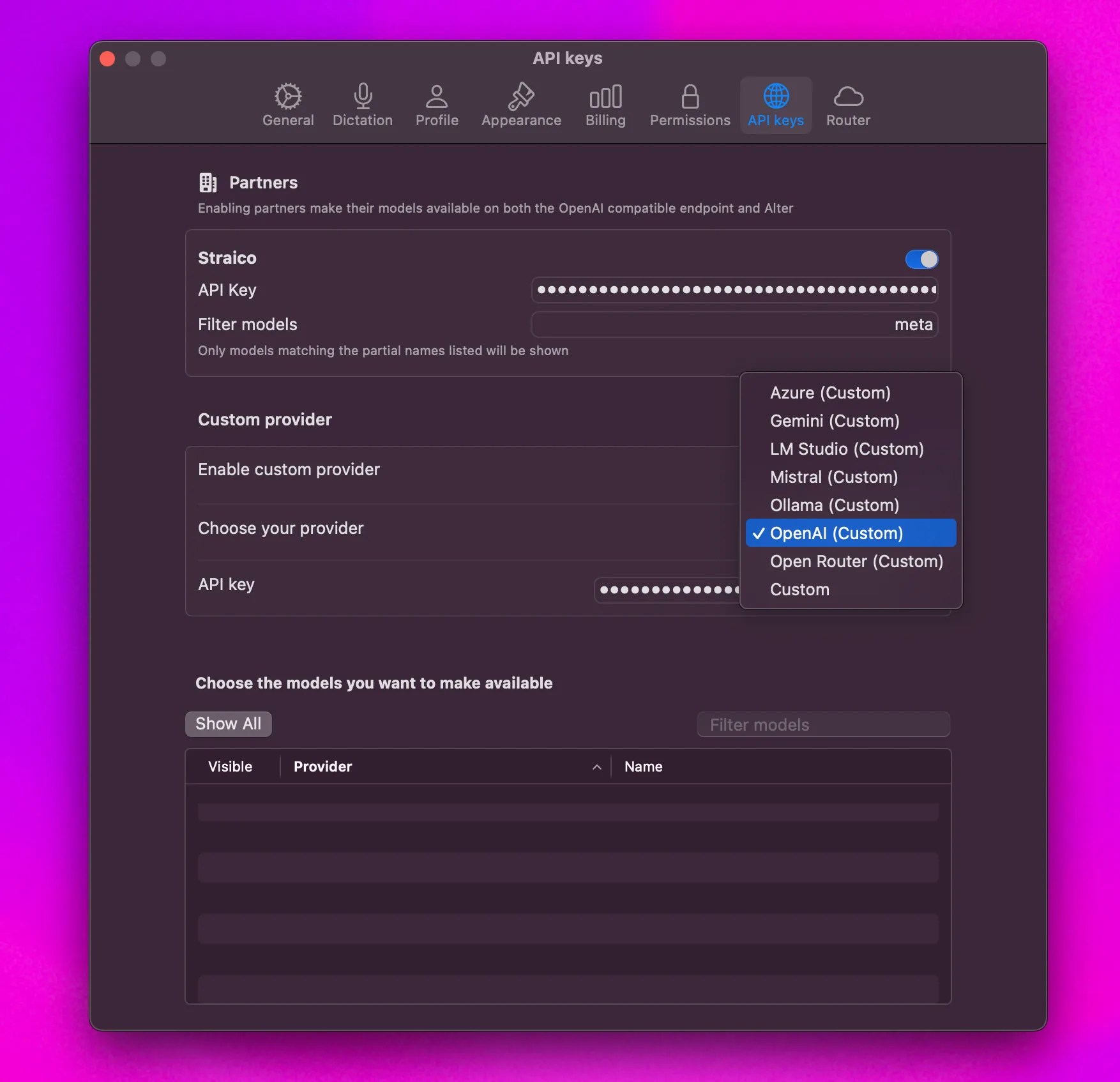

- Gehen Sie zu Einstellungen > API-Schlüssel > Benutzerdefinierter Anbieter.

- Aktivieren Sie Benutzerdefinierter Anbieter

- Wählen Sie Ihren Anbieter aus der Liste aus

Sobald Sie verbunden sind, erscheint ein Häkchen neben Custom Endpoint.Die Modelle Ihres Anbieters werden im Abschnitt Custom aufgeführt.

Wir unterstützen nur OpenAI-kompatible Endpunkte, was bedeutet, dass Sie Ihre Anthropic API-Schlüssel nicht verwenden können.Hier ist eine Liste der unterstützten Plattformen für benutzerdefinierte Schlüssel, basierend auf dem bereitgestellten Bild:

- Azure

- Gemini

- LM Studio

- Mistral

- Ollama

- OpenAI

- Open Router

- Benutzerdefiniert (Jeder OpenAI-kompatible Endpunkt)

Einrichten eines Azure-Endpunkts in Alter

- Benutzerdefinierten Anbieter aktivieren: Aktivieren Sie in den Einstellungen von Alter die Option “Benutzerdefinierter Anbieter”.

- Wählen Sie Azure: Wählen Sie Azure als Ihren Anbieter.

- Geben Sie die vollständige URL des Chat Completion Endpunkts ein: Geben Sie die vollständige URL des Chat Completion Endpunkts ein, einschließlich des

api-versionParameters und des Modellnamens in der URL. Zum Beispiel:https://yourinstance.openai.azure.com/openai/deployments/your-model-name/chat/completions?api-version=2024-02-15-preview - Geben Sie Ihren API-Schlüssel ein: Geben Sie Ihren Azure OpenAI API-Schlüssel ein.

- Vollständiger Endpunkt erforderlich: Stellen Sie sicher, dass Sie den vollständigen Chat Completion Endpunkt verwenden, da Alter den Modellnamen aus der URL extrahiert.

- Modellname in der URL: Der Modellbereitstellungsname muss im URL-Pfad enthalten sein.

- API-Version: Die URL muss den Parameter

api-versionenthalten.

Wo Sie Ihre API-Schlüssel finden

| Anbieter | URL zum Erstellen eines API-Schlüssels | |

|---|---|---|

| Google (Gemini) | https://aistudio.google.com/app/apikey | Link |

| Mistral | https://console.mistral.ai/api-keys/ | |

| OpenAI | https://platform.openai.com/api-keys | [Link] |

Lokal mit Ollama oder LM Studio verwenden

Um Alter mit lokalen Modellen (über Ollama oder LM Studio) zu verwenden:

Um Alter mit lokalen Modellen (über Ollama oder LM Studio) zu verwenden:

- Gehen Sie zu Einstellungen > API-Schlüssel > Benutzerdefinierter Anbieter.

- Aktivieren Sie den benutzerdefinierten Anbieter

- Wählen Sie Ollama oder LM Studio in der Liste der Anbieter

Sobald Sie verbunden sind, erscheint ein Häkchen neben Custom Endpoint.

Ihre lokalen Modelle werden im Abschnitt Custom aufgeführt.

Ihre lokalen Modelle werden im Abschnitt Custom aufgeführt.